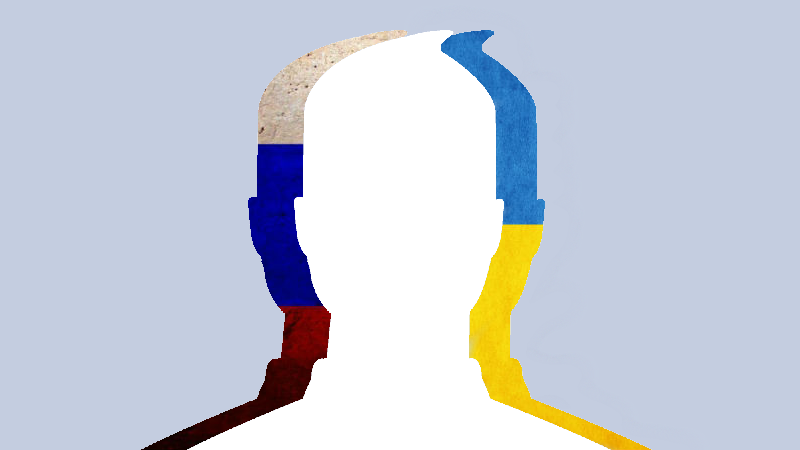

Imágenes mezcladas por Tetyana Lokot.

La guerra que ha tenido lugar en las redes sociales a raíz del conflicto ocurrido en Ucrania ha provocado que usuarios de todos los bandos recurran a medidas desesperadas: innumerables quejas, denuncias de contenido y publicación masiva de comentarios son parte del arsenal. Sancionar a los responsables es misión casi imposible a menos que infrinjan las condiciones de servicio de la plataforma.

En agosto, RuNet Echo informó del descontento generalizado entre los usuarios de Facebook de Ucrania que acusaron a la plataforma social de cerrar páginas de activistas ucranianos. Facebook decidió cerrar dichas páginas por las protestas masivas llevadas a cabo por, según los activistas, «grupos organizados pro Rusia». Los ucranianios escribieron una carta pública a Mark Zuckerberk, creador de Facebook, en la que afirmaban que los administradores de Facebook de Ucrania estaban en contra de los activistas del país.

No es la primera vez que usuarios de Facebook, desde activistas políticos del mundo árabe a defensores de los derechos del colectivo LGBT, han realizado acusaciones similares. Durante la guerra de Gaza de hace unos meses, Global Voices ya señaló lo que parecía un tratamiento desigual en cuanto a la aplicación de las normas comunitarias por parte de Facebook hacia el contenido de los usuarios palestinos en favor de los israelíes.

Le pedimos a Richard Allan, vicepresidente de política pública (Europa, Oriente Medio y África) de Facebook, que aclarara la política de contenido en los sectores de Ucrania y Rusia. Asimismo habló sobre otros intentos de «burlar el sistema» de cierre de contenidos de Facebook, y sobre las dificultades que conlleva tratar con un público plurilingüe e internacional.

Hay varios niveles en la plantilla de Facebook implicados en el proceso de moderación de contenidos. En primer lugar, el equipo de política se dedica a revisar las normas comunitarias y las condiciones de uso de Facebook y las compara con el uso que la gente hace de la plataforma. Según Allan, este equipo está formado por «un grupo de personas de todo el mundo, de varias nacionalidades, que toman decisiones acerca de esas normas internacionales». Las normas comunitarias no son fijas, sino que se van redefiniendo con el tiempo. El equipo de política trata casos excepcionales procedentes de cualquier parte de la empresa, cuando hay preocupaciones de que las políticas se estan aplicando incorrectamente o porque hay que revisarlas. Por ejemplo, hace poco Facebook decidió ampliar su política de nombres reales, algo que muchos usuarios, desde activistas de ambientes represores a drag queens, llevan años solicitando.

El otro grupo que modera los contenidos publicados en Facebook también es internacional, ya que cuenta con oficinas por todo el mundo, entre las que se incluyen Irlanda, EE.UU. e India. Aunque algunos de los moderadores están especializados en determinadas áreas, como en lenguaje ofensivo o en bullying, no actúan por países sino por idioma. Facebook contrata hablantes nativos de una gran variedad de lenguas para desempeñar ese papel dentro del sistema global de moderación.

[Por] ejemplo, tenemos el servicio lingüístico árabe que se encarga del contenido escrito en este idioma. No tenemos un equipo en Egipto y otro en el Líbano. No es así como se estructura. Se trata de una estructura global con un servicio lingüístico adicional, no un servicio específico en cada país.

En el caso de Ucrania, es importante tener en cuenta que Facebook no tiene una oficina física ni en Ucrania ni en Rusia. Facebook Ireland Limited, que cuenta con un equipo internacional de 500 trabajadores situado en Dublín, dirige todos los servicios para ambos países. Allan afirma que la representante de Facebook en ruso, Ekaterina Skorobogatova, mencionada en las quejas de los ucranianos por su falta de imparcialidad, no tiene nada que ver con la moderación de contenidos.

Su trabajo no tiene nada que ver con la moderación de contenidos. Quizá haya llamado la atención por sus comentarios, pero su trabajo consiste en entablar relaciones con operadores móviles, y se ha encargado de terceros que quieren trabajar con Facebook en Rusia porque ella es de allá, pero su puesto no tiene nada que ver con los contenidos o usuarios de Facebook. […] Si hablamos con un moderador ruso, tal vez acudamos a ella para que nos ayude con algo relacionado con el idioma, ya que no hablo ruso, pero repito que no tiene responsabilidad alguna en cuanto a contenidos o decisiones, que son competencia de otros equipos de la empresa.

Allan nos cuenta que cuando alguien denuncia algún tipo de contenido en Facebook, se somete a moderación. Si nuestro personal determina que el contenido va contra las normas de Facebook, se elimina. La incitación a la violencia y el lenguaje ofensivo son dos de los ejemplos más comunes de contenido eliminado por infringir las normas comunitarias de la página web. Se sabe que este proceso les causa problemas a los administradores de páginas eliminadas simplemente porque algún individuo publica algo que va en contra de las normas.

Es importante mencionar que Allan reconoce que hay contenidos que a veces se eliminan por error, debido principalmente a la magnitud de las operaciones de la plataforma y el hecho de que el proceso de moderación lo llevan acabo humanos.

A veces cometemos errores. Cuando moderamos grandes cantidades de contenido, puede ser que tomemos decisiones incorrectas. Si se acumula una cantidad suficiente de decisiones negativas acerca de una página, ya sean correctas o incorrectas, se podría proceder al cierre de la página. […] Reconocemos que a veces cometemos errores y, dada la escala a la que operamos, puede convertirse en un problema.

Facebook anima a los usuarios a reclamar si creen que se ha cerrado su página por error. «Activamos las páginas de nuevo si consideramos que las cerramos de forma injusta,» recalca Allan.

Un caso reciente de lo que parece ser una denuncia con tintes políticos fue el de la página «Груз 200 (Cargo 200)«, un grupo que rastrea a los soldados rusos muertos en combate en Ucrania. Actualmente, el grupo cuenta con más de 25.000 seguidores. Aunque sus miembros publican a menudo contenido delicado, como imágenes explícitas del conflicto, en principio el objetivo del grupo está acorde con las pautas de Facebook. Cuando algunos opositores del grupo lo denunciaron, la página fue cerrada el 23 de setiembre, lo cual hizo que muchos usuarios se quejaran a Facebook e incluso hicieran una petición online en la que pedían que se restaurara la página. En menos de 24 horas, Facebook reaccionó a las protestas y restauró la página del grupo.

Hay muchos usuarios de Facebook que creen que cuanta más gente denuncie un determinado contenido, más probable es que lo eliminen. Aunque el proceso pasa por un sistema en el que el contenido es marcado y moderado por el personal de Facebook, Allan explica que una gran cantidad de denuncias no es un «indicador fiable» para la compañía, ya sean de un contenido que vaya o no contra la política de la web.

Llevamos 10 años proporcionando este servicio, y siempre hay gente que intenta burlar nuestro sistema. Utilizan el sistema para llegar a otros usuarios. Una de las maneras más obvias en las que la gente intentaba burlar el sistema hace unos años era enviando denuncias múltiples para que eliminaran algún contenido que no les gustaba, así que pronto aprendimos que el hecho de que haya muchas denuncias no es un indicador fiable de que un contenido sea malo.

Cuando Facebook empieza a recibir denuncias, se revisa si el contenido va en contra de las normas y toman rápidamente una decisión sobre si el contenido supone una violación de las reglas.

Después de recibir una determinada cantidad de denuncias, sabemos que el contenido está bien, así que cuando llegan nuevas denuncias, los que las reciben saben que son acerca de contenido previamente revisado varias veces y, por lo tanto, podemos descartar cualquier otra denuncia posterior.

La táctica de los bandos pro ucraniano y pro ruso parece similar: buscan contenido que pueda ir contra las normas de Facebook e intentan que mucha gente lo denuncie. De hecho, denunciar una página puede funcionar si el contenido infringe las normas de verdad. Algunos usuarios ucranianos denunciaron con éxito de forma coordinada el grupo pro Ruso «Беркут—Украина (Berkut—Ucrania)» por contener amenazas violentas.

Allan reconoce que si una página es popular y tiene muchos seguidores, es más probable que la examinen más de cerca y, en consecuencia, es más probable que le afecte si la denuncian.

El sistema está diseñado para que funcione así: si hay contenido importante y hay mucha gente viéndolo, tiene que cumplir las normas. Una página con mucha actividad que contenga lenguaje ofensivo o que incite a la violencia supone un problema, y nos interesa ver ese contenido, moderarlo y, si es necesario, tomar medidas al respecto.

A menudo, los usuarios de Facebook denuncian contenidos simplemente porque no son de su agrado o porque no están de acuerdo con el punto de vista de alguien. Según Allan, esto sucede durante campañas políticas u otras situaciones polémicas.

[En cualquier] situación en la que la gente se siente partidaria de uno u otro bando, es un comportamiento natural, normal. Si son fanáticos, si no están de acuerdo con algo, lo denunciarán solo porque no están de acuerdo. Es una manera de expresarlo, ya que no hay botón de «No me gusta». De repente vemos un montón de denuncias y hay miles de personas denunciando algo, puede ser un partido de fútbol en el que un equipo hace algo que no les gusta y van todos a denunciar algo del Manchester United.

Cuando les preguntan si los usuarios tienen otras formas de burlar el sistema aparte de la denuncia de contenidos, especialmente en situaciones de naturaleza política, Allan menciona los comentarios en masa como otra táctica generalizada.

Hay mucha actividad que se desarrolla en forma de comentarios organizados acerca del contenido que no le gusta a la gente. Si alguien publica algo relacionado con una situación política concreta, en lugar de denuncias aparecen rápidamente miles de comentarios en contra de esa publicación. Obviamente, esa gente se coordina para publicar esos comentarios, pero si se trata de usuarios de Facebook reales que expresan sus opiniones, para nosotros no supone algo en lo que nos tengamos que involucrar, ya que se permite utilizar la plataforma para tal fin.

Técnicamente, según Allan, si una agencia gubernamental (u otro) creara cuentas para denunciar contenido en Facebook, iría en contra de las normas. Sin embargo, suele ser difícil demostrar cuando un gobierno o una organización se encuentran detrás de esas cuentas que denuncian contenido o que publican los comentarios de forma masiva. Mientras las cuentas individuales parezcan legítimas, es poco probable que Facebook las investigue o busque algún tipo de prueba de respaldo estatal en ellas.

Para muchos usuarios de internet, Facebook y plataformas similares se han convertido en espacios indispensables para la libertad de expresión. Asimismo son entidades comerciales que tratan de crear un espacio atractivo para todos sus usuarios a la vez que aplican sus normas. En Facebook es fácil denunciar el contenido que va en contra de las reglas, pero el volumen de denuncias también implica que una página puede cerrarse por error. Facebook se preocupa por la identidad real del usuario, aunque a veces se le escapan usuarios que tratan de crear «cuentas títere» muy elaboradas para manipular una discusión acerca de un tema determinado, como el conflicto de Ucrania, a través de un intento por establecer unos valores universales que definan su autenticidad.

Allan reconoce que «el comportamiento humano es así; la gente intenta esquivar el sistema» ya sea suplantando una identidad, denunciando un contenido publicado o por otros medios.

No podemos decir que la gente no encontrará nuevas formas de burlar el sistema, pero nuestra filosofía es que, si eso ocurre, intentaremos identificar esos problemas y modificar nuestro sistema para asegurarnos de que estamos protegidos ante cualquier tipo de abuso.

En situaciones delicadas, como el conflicto entre Ucrania y Rusia, las redes sociales tienen una mayor responsabilidad para con sus usuarios en cuando a la prevención del abuso de la libertad de expresión. Por ello, es importante documentar los casos de manipulación e intentos de burlar el sistema, y conceder una especial importancia al trabajo de los periodistas ciudadanos y blogueros que archivan tales casos y los comparten con el público. Como en cualquier comunidad, la integridad del ecosistema de las redes sociales se basa en que todos los bandos hablen y escuchen bilateralmente.